Il y a quelques temps j’avais parlé dans ce blog du premier satellite utilisant le principe d’intrication quantique des photons pour réaliser une transmission cryptée (voir cet article). Cette fois-ci, il ne s’agit plus de cryptographie, mais d’une technologie plus directement opérationnelle : un radar tueur de furtivité.

Bon, je préviens tout de suite, nous sommes encore une fois dans le domaine quantique, donc dans un domaine parfaitement contre-intuitif, et mon effort de vulgarisation (surtout si l’on considère que je ne suis pas physicien) risque de m’attirer les foudres des experts. Désolé donc.

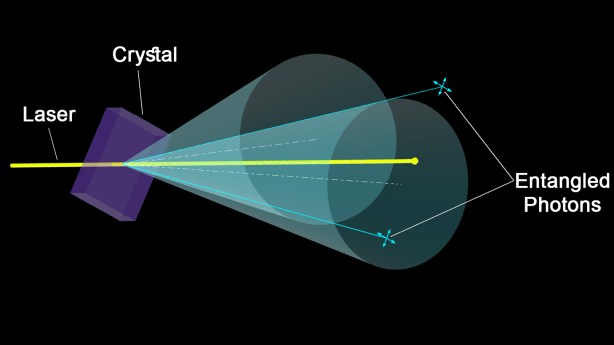

Le principe du radar quantique repose lui aussi sur le principe de l’intrication des photons, une propriété surprenante à l’échelle quantique. Pour faire simple, en physique quantique, l’état d’une particule est décrit par une « fonction d’onde ». Celle-ci correspond au spin de la particule (son moment cinétique, classiquement représenté par une flèche vers le haut ou le bas) et qui lui-même correspond à une superposition d’états. A l’échelle quantique, le spin est en effet une somme des états « vers le haut » et « vers le bas ».

Mais lorsqu’on mesure l’orientation du spin, la fonction d’onde est modifiée (« réduite ») de telle sorte que la superposition d’états disparaît et le spin observé prend, de façon aléatoire, la valeur « haut » ou la valeur « bas ». Pour l’instant, c’est encore compréhensible. Ça devient plus complexe lorsque l’on considère qu’en physique quantique, on peut avoir une généralisation de la superposition d’états à plusieurs particules. En l’occurrence, considérons 2 photons dits « intriqués » : ce sont deux particules dont les spins sont opposés. Même si ces particules sont spatialement éloignées, si l’on mesure le spin de la première, la seconde prend instantanément une valeur de spin opposée. Oui je sais, c’est bizarre. Mais c’est comme ça.

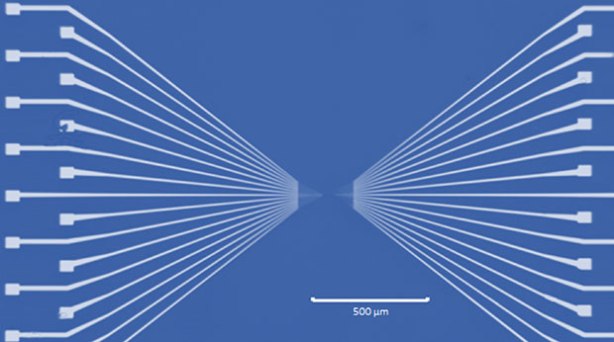

Le radar chinois repose sur ce principe. L’astuce est d’utiliser la polarisation du signal radar comme une signature quantique. Un photon est séparé, via un dispositif optique, en un couple de photons intriqués. Le radar va ainsi générer un faisceau de photons A, et un faisceau de photons B, intriqués. Les photons B sont surveillés constamment (là encore, vous comprenez que je simplifie), alors que le faisceau A est envoyé en direction de la cible. Si la fonction d’onde du faisceau B se modifie, cela signifie que le faisceau de photons A a atteint une cible, ce qui a provoqué une modification de son spin, et ainsi modifié instantanément celui du faisceau B intriqué.

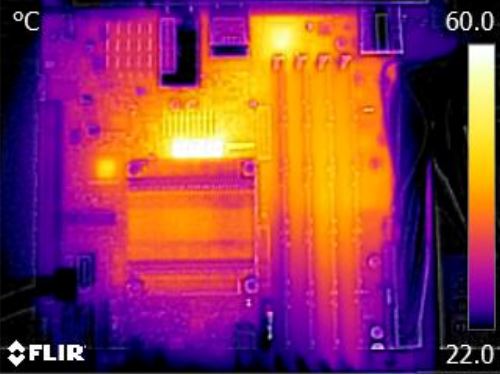

L’intérêt, c’est que cette modification est indépendante de la forme de la surface heurtée. La furtivité classique consiste à minimiser la surface équivalente radar en supprimant autant que possible la réflexion des ondes en direction du radar. Mais dans le cas d’un radar quantique, il ne s’agit pas de détecter une onde réfléchie, mais de détecter une modification de l’état d’un faisceau de photons. Les stratégies classiques de furtivité sont donc inefficaces, comme le sont les contre-mesures de brouillage : le radar quantique n’utilise pas d’ondes ! De plus, l’interaction du faisceau de photons avec la cible est caractéristique de la nature de la cible elle-même : en observant les modifications du faisceau B, on arrive à caractériser la cible, sa position, sa vitesse et ses propriétés physiques.

Ce radar a été développé par le Intelligent Perception Technology Laboratory du CETC (China Electronics Technology Corporation). Selon l’agence de presse chinoise, le système aurait réussi à détecter une cible à une distance de 100km. Ce n’est effectivement qu’une preuve de concept, et l’utilisation militaire d’une telle technologie nécessite évidemment des portées bien plus importantes. Il y a d’ailleurs là une difficulté : ce que l’on appelle la décohérence. Car plus les particules intriquées passent de temps dans le monde réel, plus elles ont tendance à perdre leurs propriétés quantiques. Lockheed Martin avait d’ailleurs tenté à plusieurs reprises de réaliser un tel radar, avant de se heurter au principe de décohérence.

Les allégations chinoises sont difficilement vérifiables, mais il est néanmoins vrai que la maîtrise d’une telle technologie constituerait une rupture capacitaire et stratégique. Une véritable réflexion sur l’impact de telles innovations (informatique et technologies quantiques, convergence NBIC, …) et sur leur financement, pour éviter à notre pays et à notre continent toute surprise stratégique majeure me semble aujourd’hui indispensable. Mais ce n’est que mon avis.