Cette semaine, rencontre avec l’un de mes amis, David Menga, que certains d’entre vous connaissent sûrement. David est expert dans l’Internet des Objets, l’IA et blockchain appliqués à la smart home, au smart building et à la smart grid.

Dans la vie, il est chercheur à l’EDF Lab et coordinateur technologique du pôle de compétitivité Normand TES (Transactions Electroniques Sécurisées). Il a co-édité avec Nobuo Saito, professeur émérite de l’Université Keio au Japon, un livre intitulé « Ecological Design of Smart Home Networks, Social Impact and Sustainability ». Bref, un chercheur, un curieux insatiable, et un homme de vision notamment dans le domaine de l’Intelligence Artificielle dont nous allons bien évidemment parler. Petite interview entre amis:

David, tu es chercheur à l’EDF Lab. Bon, aujourd’hui toutes les institutions et tous les grands industriels ont leur lab. Alors c’est quoi, l’EDF Lab – un lab de plus ou un précurseur?

EDFlab est le plus grand centre industriel de recherche et formation en Europe. Son rôle est de préparer l’avenir du groupe EDF, à la croisée des mutations numériques et énergétiques.

Quelles sont tes thématiques et sujets de prédilection ?

Je travaille beaucoup sur les nouveaux relais de croissance pour la branche commerce d’EDF, comment aller au-delà de la vente simple d’électrons et offrir des services à valeur ajoutée à nos clients. Cela signifie trouver des positionnements pertinents pour EDF dans un monde numérique massivement connecté et en pleine transition énergétique vers des systèmes de production décentralisées et renouvelables. Je travaille concrètement sur la digitalisation des tableaux électriques, la transformation des supports d’éclairage en plateformes de services, et la mise en œuvre de coachs énergétiques à travers des intelligences artificielles capables de raisonner et de dialoguer avec un utilisateur en argumentant.

Alors pour les lecteurs de ce blog, tout ceci ne parle pas encore d’innovation de défense, mais bien évidemment, les technologies sont connexes – tu as d’ailleurs participé au projet SOFLAB organisé par le Cercle de l’Arbalète. Allons donc dans le dur – dans ce blog, j’ai beaucoup parlé à la fois des « games changers » comme l’hypervélocité, l’IA et le big data, le quantique (au sens large)… et des pays qui se dotent massivement de moyens pour participer à cette course à la technologie. En particulier la Chine. Quelle est ta perception de la « géostratégie » des ruptures technologiques dans le domaine ? Et d’ailleurs, vois tu d’autres ruptures que celles que j’ai citées ?

Je vois particulièrement des ruptures dans l’univers de la biologie et de la chimie quantique.

J’entrevois l’évolution des usines chimiques actuelles en usines bactériennes programmables capables de produire à la demande les matériaux indispensables à notre civilisation moderne, offrant les mêmes qualités d’usage et biodégradables.

J’entrevois la possibilité grâce au ordinateurs quantiques, de fabriquer à la demande de nouveaux matériaux répondant à des cahiers des charges précis. Ce serait une évolution majeure de l’imprimante 3D.

Plus généralement, je pense que nous allons basculer dans l’ère post silicium, celle du carbone dont on redécouvrira les bienfaits une fois capturé et domestiqué à des coûts acceptables. En particulier, je pense que l’électronique au graphène et aux nanotubes de carbone va se développer dans la prochaine décennie.

La conséquence de tous ces progrès sera une révolution dans l’énergie, la manière dont on la produit (panneaux solaires au rendements proches de 50 % , turbines au CO2 , éoliennes silencieuses et performantes ) , la manière dont on la distribue ( câbles supraconducteurs, réseau intelligent tolérant aux pannes, courant continu ) et enfin la manière dont on la consomme. Les réseaux énergie sans fil vont se développer avec la mobilité électrique.

La santé est aussi un secteur à fort potentiel d’évolution, avec les progrès de la médecine personnalisée, prédictive, préventive et régénérative. La génomique et l’épigénétique sont au cœur de cette révolution. Enfin, j’entrevois de nouveaux modèles économiques où le consommateur est au centre de la proposition de valeur grâce à la blockchain.

Pour l’instant, toutes ces transformations sont tirées par la Chine et les Etats Unis. L’Europe place ses efforts dans la règlementation et l’éthique, certes nécessaires mais non producteurs de richesses.

De la même manière, on assiste à la consolidation des acteurs privés de la technologie – les GAFA (Google, Apple, Facebook, Amazon) mais pas seulement. Quelle est ta vision de l’évolution du paysage, et qu’anticipes-tu comme impact dans le domaine de la défense et de la sécurité ?

Je pense que les grandes entreprises GAFA et BATX (note : BATX = Baidu, Alibaba, Tencent et Xiaomi) vont prendre de plus d’importance dans les états où ils opèrent. L’affaire Cambridge Analytica montre les dérives d’un système sans contrôle, avec la manipulation à large échelle de l’opinion, ce qui pose des problèmes de sécurité nationale.

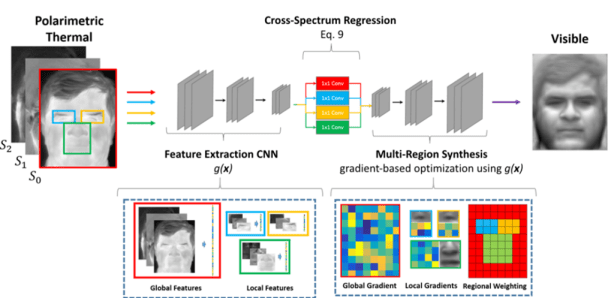

De plus, leur maîtrise de l’IA les rendra indispensables pour construire des systèmes de défense efficaces, comme le montre l’utilisation de l’outil Tensorflow de Google par les militaires américains. (Note: voir mon dernier article sur le projet MAVEN)

Parlons d’IA. La mission Villani vient de s’achever et le président a présenté le rapport il y a deux semaines lors d’une « grande messe de l’IA » au Collège de France (une première dans le domaine). En premier lieu, que penses-tu de ce rapport et des préconisations qui y sont présentées ?

Le rapport Villani pose un bon diagnostic sur l’importance de l’IA dans la société, mais apporte des réponses trop sectorielles, trop limitées. Plus de recherche en deep learning, plus de données en mode ouvert, plus de puissance de calcul disponible pour les scientifiques, cela ne constitue pas une réponse industrielle au retard colossal de la France en la matière. Cela renforce la vassalisation de notre recherche aux intérêts des géants de l’Internet, GAFA ou BATX.

D’ailleurs, le jour même, Google comme Samsung annonçaient la création d’un centre de recherche IA en France. Matière grise en France, subventionnée par le contribuable et profits à l’étranger, renforçant notre déficit commercial.

En un mot, le rapport Villani est un « plan calcul du deep learning ». Nous connaissons tous la suite.

C’est sévère. Alors pour rester compétitive dans ce domaine, que doit faire la France, notamment dans le domaine du hardware (et de l’open hardware) ?

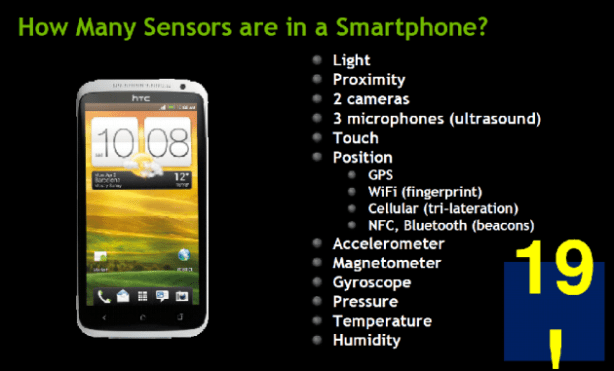

La France doit investir massivement dans l’IA post deep learning, l’IA prévisionnelle, capable de raisonner et de planifier dans un univers incertain, avec des informations parcimonieuses et incomplètes. Une IA capable d’apprendre à partir de ses expériences sensorielles et de ses interactions avec les humains, intégrable dans des systèmes embarqués à basse consommation, autant qu’une lampe LED. Bref, une IA capable de s’adapter à des contextes variables en milieu ouvert.

Cela requiert de nouveaux hardwares à inventer, une nouvelle architecture post Von Neumann, couplant données et traitements et d’immenses facultés de parallélisation des tâches. Et bien sûr , une nouvelle façon de concevoir des algorithmes et de les implémenter. Le cerveau fournit un bon modèle qu’il s’agira de comprendre et de dépasser. L’Open Hardware, comme le RISCV , doit être au cœur de ce programme ambitieux car il ne s’agit pas de réinventer la poudre. Inspirons nous du programme Celerity de la DARPA.

La France doit mettre l’IA au cœur de ses formations qualifiantes, pour habituer les étudiants à mieux collaborer avec elles. Il s’agit d’offrir aux étudiants des « Legos » IA programmables et composables, le tout avec de l’open hardware et de l’open source. Il importe de créer une industrie des machines outils de l’IA, des IAs capables de fabriquer d’autres IAs plus spécialisées à partir de composants open source ou pas.

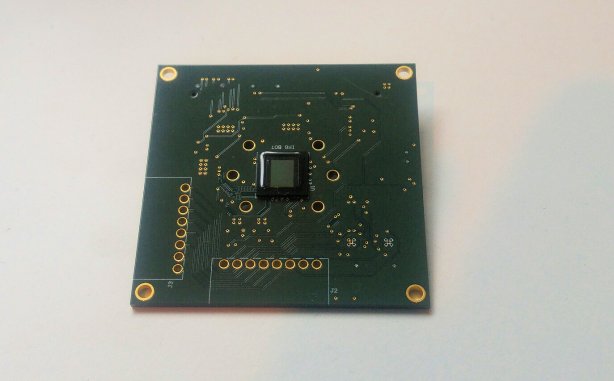

Pensez à une IA de conception de circuits électroniques comme celle de Thingtype

couplée à une imprimante 3D de PCB comme celle de Nanodimension plus une IA de génération de logiciel. Il s’agit de construire des produits/services intégrant directement de l’IA et répondant à un cahier des charges précis. En un mot, la France doit maîtriser les outils pour bâtir ce que j’appelle « l’atmosphère IA», c’est dire des IAs massivement intégrées dans notre société.

Enfin, Elon Musk a dit « le meilleur moyen de se faire une petite fortune dans le domaine spatial, c’est de commencer avec une grosse ». Si tu avais aujourd’hui de l’argent pour financer des projets innovants, et je parle là du domaine de la défense et de la sécurité au sens large, que penserais tu financer ?

En toute cohérence, j’investirais massivement dans ces fameuses « machines-outils IA » permettant de produire des IA embarquées à vocation militaire, capables de remplir soit des missions de renseignement dans des drones miniatures de type libellule, soit des missions d’attaque en essaims avec des armes infrasoniques.