Après mon dernier poisson d’avril (oui, c’en était un et il a mieux fonctionné que je ne le pensais), je reprends le fil des « véritables » nouvelles (je rappelle que le premier avril est le seul jour où les internautes sont supposés vérifier une information avant de la croire – sic).

En l’occurrence, une nouvelle qui commence à faire du bruit, et qui a déclenché l’ire des employés de Google ; le géant du net, désormais l’un des pionniers du « deep learning », fournit sa technologie au Pentagone, notamment pour réaliser l’analyse d’images prises par des drones ou des satellites.

Cela fait un certain temps qu’on le rappelle : l’intelligence artificielle est aujourd’hui tirée par le marché civil, et en particulier le grand public. Les investissements se poursuivent et même s’amplifient dans des sociétés proposant des technologies d’apprentissage machine ou d’intelligence artificielle. Dernière en date, la « licorne » chinoise SenseTime qui vient d’annoncer avoir procédé à une levée de fonds de 600 M$, pour une valorisation de la société à 4.5 milliards (oui, milliards) de dollars… Nul doute d’ailleurs que le vaste programme d’espionnage des citoyens chinois – digne du meilleur épisode à mon sens de la série Black Mirror (« the fall ») – a contribué à valoriser les programmes de reconnaissance faciale et d’analyse d’images.

L’avance de sociétés comme Facebook, Apple ou Google dans le domaine de l’IA n’est plus à prouver. C’est donc naturellement que le Pentagone s’est tourné vers Google quand il a réalisé qu’il ne pourrait traiter manuellement le torrent d’informations (images et vidéos) déversé par les drones militaires.

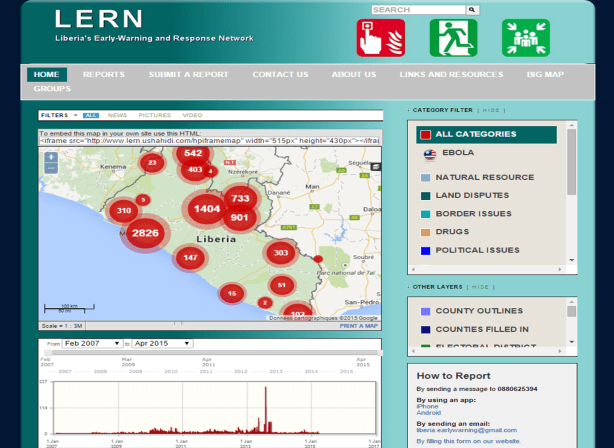

Le programme s’appelle donc Maven, et est réalisé depuis 2017 par une équipe mixte (Google et le DoD américain) baptisée AWCFT pour Algorithmic Warfare Cross-Functional Team. En 2017, Greg Allen et Taniel Chan avaient publié ce rapport dont je vous conseille la lecture – le même Greg Allen a récemment déclaré que si le ministère de la défense américain a bien financé de manière importante le développement de nouveaux capteurs image pour les drones aériens, il a en revanche un peu négligé les outils d’analyse nécessaires afin de donner du sens aux données recueillies.

Pour mieux en juger, voici quelques chiffres : l’armée américaine s’est équipée de 11 000 drones aériens (!). Chacun de ces drones génère un déluge de données images (au total, l’équivalent de 37 années de vidéo)…et 99% de ces données ne sont analysées par personne. En France, le général Ferlet, commandant la Direction du Renseignement Militaire, a également évoqué le sujet sur Europe 1 en décembre dernier: « Il y a une explosion exponentielle des données à traiter. Mais je ne suis pas naïf, je n’aurais pas une augmentation exponentielle des moyens humains pour traiter ces données. Il faudra donc trouver d’autres moyens, basés sur l’intelligence artificielle. Ce sera ma priorité numéro une dans les années à venir ».

Retour donc au projet Maven. Son premier objectif : utiliser l’IA et l’apprentissage machine pour détecter et identifier des objets (véhicules…) dans les vidéos transmises par les drones. En tout, dans cette première phase du projet, 38 catégories d’objets ciblés ont été définies. Pour ce faire, du logiciel bien sûr, mais pas seulement. A priori, Google fournirait des API Tensorflow aux équipes du ministère.

Rappelons que Tensorflow, développé par Google, est un outil open source de référence dans le domaine de l’apprentissage machine – éventuellement, la société pourrait fournir également du hardware, en l’espèce, des circuits Tensor (circuit intégré développé par Alphabet/Google spécifiquement pour l’IA).

L’idée est d’accélérer au maximum le projet Maven, un projet déjà tendu puisque six mois après son lancement, l’été dernier, le projet était supposé déjà opérationnel (en particulier dans la lutte contre le terrorisme en Irak et en Syrie).

Bon, le projet Maven ne plait pas à tous ; des milliers d’employés de Google ont ainsi signé une pétition demandant à l’entreprise de mettre fin à sa collaboration avec le Pentagone. A cela, certains rétorquent que justement, l’objectif de Maven était d’éviter des frappes mal ciblées, et des dégâts collatéraux en optimisant l’efficacité des drones. Gonflé.

Mais les risques de dérive sont réels. S’il s’agit de classer des images pour présenter ensuite à des analystes humains les plus susceptibles de fournir des informations tactiques, alors il faut être certain (1) que le système ne peut pas être piraté (car on peut « orienter » l’apprentissage) et d’ailleurs (2) qu’il n’y a pas de biais natifs dans la base d’apprentissage.

Revenons sur le « hacking » des systèmes d’IA ; c’est par exemple ce que l’on appelle aujourd’hui des « BadNets » : des réseaux de neurones dont la base d’apprentissage a été volontairement altérée pour introduire des signaux destinés à permettre à un hacker de modifier la réponse du système dans certaines conditions. Ainsi, à titre d’illustration, en utilisant des micro-modifications de pixels, un hacker peut permettre à un système de détection faciale de laisser passer les images de terroristes sans lever d’alarme. Je vous conseille par exemple la lecture de cet article qui démontre comment on peut arriver à faire en sorte qu’un réseau de neurones dont l’apprentissage a été altéré puisse dans certaines conditions prendre un panneau Stop pour un panneau de limitation de vitesse (je vous laisse imaginer les conséquences pour un véhicule autonome).

Au-delà, cette méthode (utiliser un partenariat avec l’industrie privée pour accélérer le tempo de développement d’une application de défense) illustre bien la philosophie prédominante aujourd’hui : en l’occurrence, c’est la structure DIUX (Defense Information Unit Experimental) située au cœur de la Silicon Valley qui est chargée d’identifier et d’organiser les transferts possibles.

Une approche qui pourrait fonctionner en France (c’est en tout cas dans la lignée des annonces réalisées autour de l’innovation de défense par la Ministre des armées) – à condition toutefois de mettre en place des dispositifs permettant à l’Etat d’acheter très rapidement des solutions commerciales, pour expérimentation immédiate. Une approche novatrice qui, je le pense, est indispensable pour aller au-delà des intentions, et capturer l’innovation de manière optimale. Faute de quoi, il sera difficile d’établir de véritables passerelles entre ces deux mondes qui aujourd’hui, au-delà des réticences « philosophiques » qu’il ne m’appartient pas de commenter, se côtoient sans véritablement s’intégrer.