Oui, le sujet de ce post est assez énigmatique. Depuis quelques semaines, je multiplie les articles sur l’IA et ses applications militaires ou de sécurité, pour coller à l’actualité. Aujourd’hui, voici deux exemples assez concrets (voire un peu inquiétants) qui touchent au « deep learning » et dont les applications sont véritablement impressionnantes.

Reconnaître des visages dans le noir

La reconnaissance faciale est l’une des technologies les plus connues et les plus immédiates du « deep learning ». Au passage, je me permets un petit rappel, tout le monde n’étant pas spécialiste de l’intelligence artificielle. Le deep learning est un sous-ensemble des techniques d’apprentissage machine à base de réseaux de neurones – le principe est de décomposer de manière hiérarchique le contenu d’une donnée complexe comme de la voix ou une image pour la classifier ensuite.

Le terme de deep learning a été inventé par Yann le Cun, actuel directeur du laboratoire d’IA de Facebook en France, pour « booster » sa recherche de fonds dans le domaine des réseaux de neurones qui était alors tombé en déshérence. Au-delà, il regroupe aujourd’hui nombre de techniques d’apprentissage à base de réseaux de neurones profonds, qui ne s’appuient pas sur des règles établies par avance. C’est, au passage, un problème : comme le souligne le rapport Villani, le deep learning est une « boite noire », car on se trouve dans l’incapacité de décrire de façon intelligible le résultat produit sur chaque nouveau cas, et en particulier à pointer les caractéristiques les plus importantes du cas en question ayant conduit au résultat produit.

En l’occurrence, ces techniques sont très efficaces par exemple pour reconnaître des visages : à la fois en raison de la disponibilité d’images pour réaliser l’apprentissage, et de par le développement considérable des capacités de calcul (GPGPU par exemple), des sous-types de réseaux de neurones profonds comme les DCN (deep convolutional neural networks – je ne rentre pas dans le détail) sont capables de reconnaître des visages avec des performances proches de l’humain (voir par exemple le projet DeepFace).

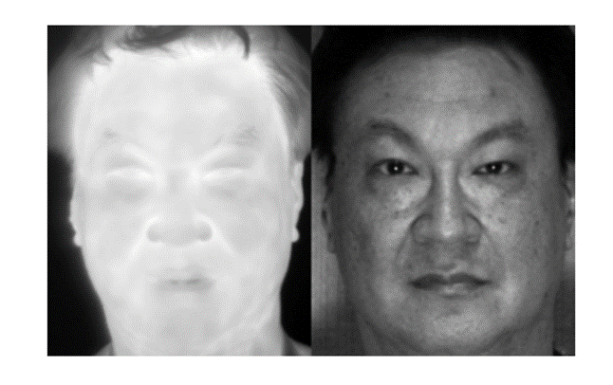

Mais cela, dans le spectre visible. Dans l’obscurité, on traite les images infrarouge, et cela pose un problème car les taux de reconnaissance chutent alors de façon drastique. La nuit, ou même dans certains cas où l’illumination n’est pas suffisante, les techniques de reconnaissance biométrique par réseaux de neurones ne peuvent plus fonctionner, sauf à utiliser une lampe torche, ce qui manque évidemment d’une certaine discrétion. La raison est simple : les visages à reconnaître en infrarouge doivent être combinés à une image provenant d’une base de données qui, elle, a été créée en lumière visible. Comme on le voit sur l’image ci-dessous, la comparaison est difficile.

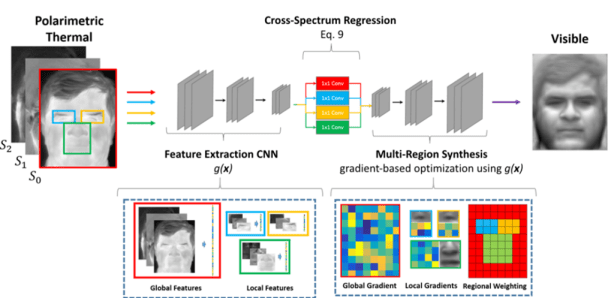

Pour surmonter ce problème, des chercheurs du ARL (US Army Research Laboratory) et de la firme Booz Allen Hamilton ont imaginé utiliser les réseaux de neurones afin de synthétiser à partir d’une image infrarouge, un visage en lumière visible qui, lui, pourra être comparé aux bases de données normales. Pour ce faire, ils utilisent une double technique : une régression non linéaire à l’aide de réseaux DCN pour extraire des caractéristiques de l’image thermique et construire une première représentation du visage, puis une synthèse et une optimisation des gradients permettant de projeter cette représentation dans le domaine visible – voir le processus ci-dessous et se reporter à l’article suivant qui donne tous les détails .

Le résultat est spectaculaire : l’image synthétisée correspondant au visage non visible en thermique plus haut, est cette fois-ci beaucoup plus proche de sa représentation dans la base de données, ce qui permet une identification par des techniques de biométrie elles-mêmes fondées sur l’utilisation de réseaux de neurones.

Et cela fonctionne très bien: lors de la conférence, les chercheurs ont ainsi utilisé une caméra thermique FLIR Boson 320 avec un portable permettant de faire tourner la démonstration en quasi temps-réel.

Mais les apports du deep learning ne s’arrêtent pas là…

Simuler un visage… et l’animer

Regardez cette vidéo. Non mais regardez-la vraiment….et jusqu’au bout.

Ce n’est donc pas Barack Obama qui parle, mais une combinaison d’une captation de son visage et d’un algorithme permettant de remplacer le mouvement de ses lèvres par un mouvement synthétique. Le résultat : on peut lui faire dire n’importe quoi, et je vous défie de le détecter. Impressionnant, et effrayant. Merci à mon fils qui m’a permis d’identifier et d’étudier cette vidéo.

C’est ce que l’on appelle un « deep fake » : un montage extrêmement réaliste permettant de simuler de manière photoréaliste, et grâce à l’IA, une vidéo plus vraie que nature. L’origine de ces fausses vidéos ? Un développeur opérant sur Reddit, sous le pseudonyme de « deepfakes », qui a adapté des techniques de deep learning en source ouverte, afin de substituer un visage de synthèse à un visage réel. Depuis (et après pas mal d’applications dans la pornographie, je vous laisse imaginer) la technique est devenue accessible à tous. L’exemple de Barack Obama montre ce qui est possible de faire, lorsque l’on est un tant soit peu professionnel.

L’idée est de rassembler le plus d’images possibles de la cible (c’est pourquoi généralement les deep fakes s’attaquent à des personnalités publiques, dont les images circulent en grand nombre sur Internet). L’imposture consiste ensuite à apprendre (par deep learning) les traits caractéristiques de la cible – en l’occurrence le mouvement des lèvres – et à les remplacer par une image de synthèse commandée en temps réel par le « marionnettiste » (un individu dont on capte les mouvements des lèvres qui sont ensuite projetés sur les mouvements des lèvres de la cible).

Le souci c’est que l’on croit tout ce qui est sur Internet (la preuve dans mon article du 1er avril largement relayé, ce qui me fait encore rire) et que l’on croit encore plus ce que l’on voit. Ces techniques, qui relevaient il y a un an du projet scientifique, sont aujourd’hui démocratisées et accessibles. Le diagnostic est donc immédiat et fait peur : on ne peut plus croire ce que l’on voit. Reste donc à imaginer des algorithmes permettant, en identifiant les subtiles différences, à détecter l’imposture, et à discriminer le « deep fake » du vrai. Mais si cela reste possible pour les spécialistes et les scientifiques, il sera toujours facile pour un grand nombre d’entre nous de prendre l’image pour la réalité. Une nouvelle ère s’annonce donc, dans le domaine de la propagande et des manipulations psychologiques, une ère dans laquelle la prudence voire la méfiance s’imposent. Et cela, ce n’est pas drôle…