Allez, un article un peu plus long : c’est le week-end!

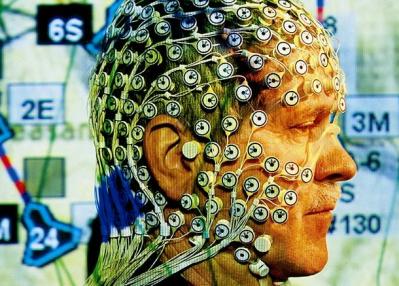

Nous avions évoqué dans cet article l’essor des interfaces permettant de capturer, débruiter et interpréter les ondes cérébrales d’un sujet. En soi, c’est déjà un problème complexe. En effet, plusieurs techniques existent : celles se fondant sur l’activité EEG de l’utilisateur au cours du temps (exemple: rythmes EEG), qui ne nécessitent pas de stimulus externe et celles se fondant sur la mesure des potentiels évoqués (ou Evoked Response Potential, ERP), qui requièrent la présence d’un stimulus précisément daté.

Capturer les signaux

Dans tous les cas, il ne s’agit pas d’une « simple » analyse, comme si l’on lisait directement le cerveau de l’utilisateur. La subtilité consiste, à partir d’un état « brut » capturé via des casques du commerce, d’utiliser des techniques d’analyse de données et d’apprentissage machine afin d’en extraire un « état cérébral » pouvant être utilisé pour surveiller le fonctionnement du cerveau ou déclencher une interaction entre l’homme et la machine. Dans ce domaine, la France est en avance, avec notamment l’INRIA qui a développé la plate-forme open source OPEN VIBE, qui permet de réaliser cet enchaînement de traitements complexes : capture, prétraitement & filtrage du signal (souvent bruité, en particulier si des électrodes sont placées sur les muscles faciaux, extraction des caractéristiques des signaux, classification.

J’en profite pour mentionner la brillante PME MENSIA Technologies, start-up issue de l’INRIA et du projet ANR OPENVIBE, installée à Rennes et à Paris, et qui a développé plusieurs logiciels commerciaux autour des briques technologiques OPENVIBE. MENSIA TECHNOLOGIES mène en outre plusieurs projets dans le domaine du monitoring et de l’entraînement cérébral basé sur la neurologie quantitative temps réel. Voici ci-dessous une démonstration des outils développés et industrialisés par MENSIA :

Emettre des commandes

Lorsqu’à cette chaîne de traitement (capture=>classification) on ajoute une étape de traduction, on obtient ce que les anglo-saxons appellent « thought controlled computing » : le contrôle commande d’un ordinateur par la pensée. Le résultat est impressionnant, qu’il s’agisse d’un simple « contrôle de l’environnement » à des fins ludiques :

Ou d’un contrôle commande pouvant par exemple pallier un handicap, en permettant d’envoyer des informations de déplacement à un fauteuil, par la pensée :

A quoi cela sert-il dans notre domaine ?

Applications pour la défense

Nous avons déjà évoqué l’utilisation de l’analyse des signaux EEG pour des utilisateurs de simulation. Les modèles et techniques d’analyse pour caractériser l’état cognitif permettent une interprétation automatique de l’état de l’apprenant (stressé, concentré, surchargé d’information,etc…) moyennant une calibration de quelques minutes. Le monitoring au sein du simulateur de l’état cognitif au sens large et de la charge mentale de l’apprenant en particulier, permet ainsi d’envisager une optimisation des processus de formation et d’entraînement, pour une meilleure interaction subséquente des opérateurs avec leur environnement. Le feedback rapporté au formateur pilotant le scénario de formation permettra d’enrichir les outils à disposition pour évaluer les potentialités opérationnelles, ainsi qu’à la possibilité d’amélioration de l’ergonomie des interfaces utilisateurs pour une meilleure efficience du couple opérateur-système.

Au delà de la simulation, en termes de perspectives, la mise en œuvre d’outils de mesure de l’état cognitif dans un simulateur est un premier pas vers la conception de cockpits totalement adaptée au traitement cérébral de l’information. En ce sens, le programme pourra être adapté aux IBEOS (illustrateurs de besoin opérationnel) tels que le simulateur SISPEO mis en service au sein de la DGA (Techniques Terrestres/SDT/IS/S2I, sur le site de Bourges).

Mais dans le domaine du contrôle commande, des expérimentations sont par ailleurs en cours pour intégrer ces dispositifs dans des contextes opérationnels : la plus récente à notre connaissance concerne le pilotage d’avion sur un vol complet – pour l’instant dans un simulateur -, atterrissage et décollage inclus :

On peut également mentionner le pilotage de drones, la commande neurale permettant de se consacrer à des tâches tactiques complexes en laissant le pilotage de bas niveau à la charge du drone. D’une manière générale, ce type de technologies est adapté au contrôle commande de robots semi-autonomes, et de nombreuses expérimentations sont à l’étude dans ce domaine.

Vers la « télépathie opérationnelle »?

Enfin, la DARPA américaine travaille sur un projet dit « Silent Talk » permettant d’utiliser les IHM neurales… pour faire de la communication de cerveau à cerveau silencieuse sur le théâtre d’opérations. Ce petit projet (financé à hauteur de 4MUSD) est avant tout un projet… de mathématiques. Caractériser, filtrer, isoler et interpréter les signaux pertinents d’un combattant sur le champ de bataille est, d’après le Dr Elmar Schmeisser de l’US Army, un problème mathématique « cruel » qui pourrait mobiliser les équipes de recherche pour 20 ans. L’US Army travaille néanmoins sur le projet d’un « thought helmet » permettant d’ores et déjà de capturer l’état mental du soldat.