Je commence par souhaiter à tous mes lecteurs une excellente année 2018, avec une pensée spéciale et sincère pour tous nos soldats en opérations, en OPEX comme sur le territoire national. L’innovation technologique de défense est surtout et d’abord au service des hommes et femmes qui nous protègent. Merci à elles et eux.

Pour débuter l’année, une annonce de nos alliés américains, qui concerne le LCS, ou Littoral Combat Ship. Pour mémoire, le LCS est un programme qui désigne les nouvelles frégates furtives américaines, de différentes classes (Classe Independence de type trimaran, Classe Freedom monocoque) dont environ dix exemplaires ont été construits à ce jour. Il s’agit de navires destinés, comme leur nom l’indique, à être engagés en zone littorale pour traiter en particulier des menaces asymétriques.

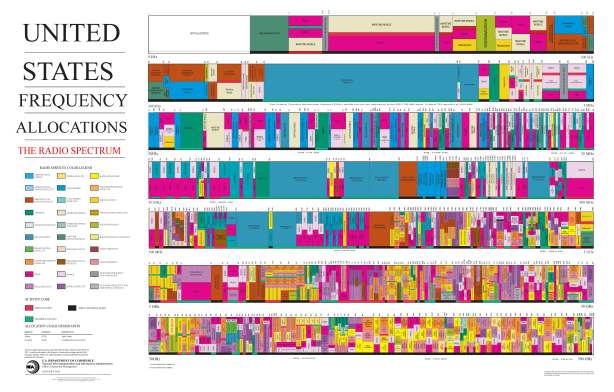

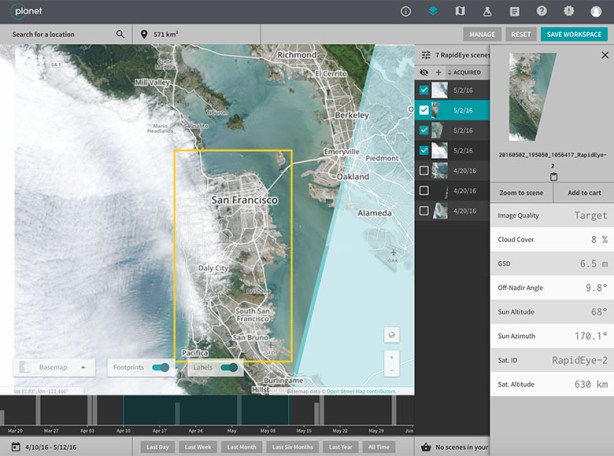

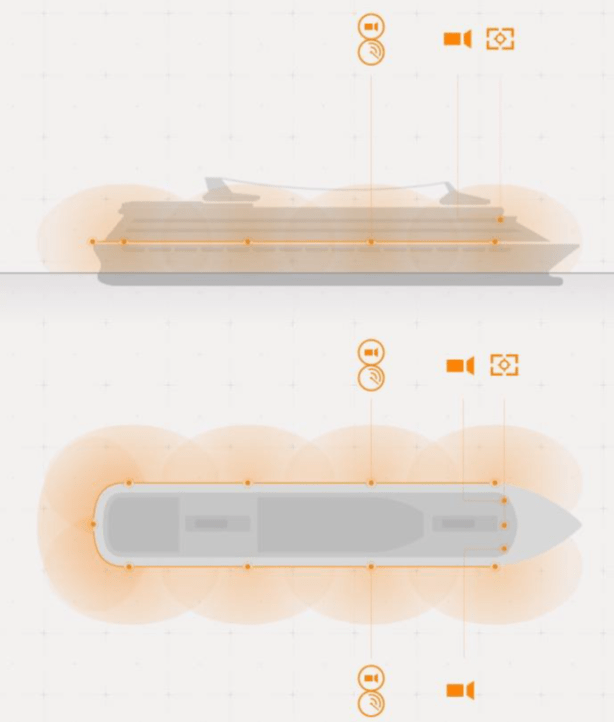

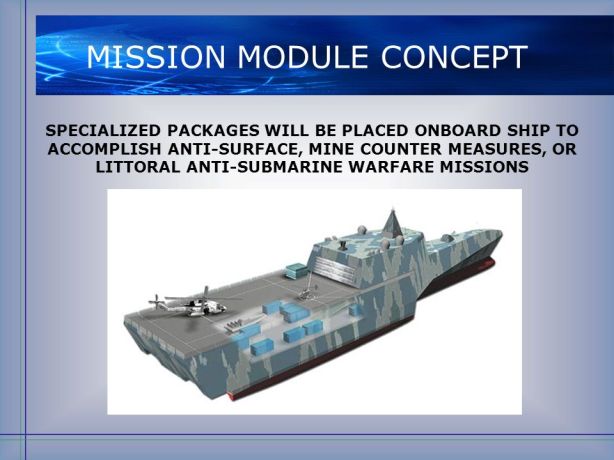

Ces frégates ne sont pas surarmées (et le programme est d’ailleurs sous le feu de nombreuses critiques aux USA notamment pour certains doutes concernant leur survivabilité au combat); elles comptent plusieurs variantes (chasse de mines, lutte anti-sous-marine, module amphibie, traitement des menaces de surface). Elles sont conçues pour intervenir au sein d’une force constituée de plusieurs LCS mais aussi de navires plus puissants (destroyers) pour assurer leur protection, et d’une bulle de renseignement (AWACS, drones, surveillance satellitaire). Tout ceci pour dire que le concept de Littoral Combat Ship est en réalité indissociable du concept de guerre infocentrée (NCW ou Network Centric Warfare). Les frégates LCS n’interviennent donc jamais seules en opérations.

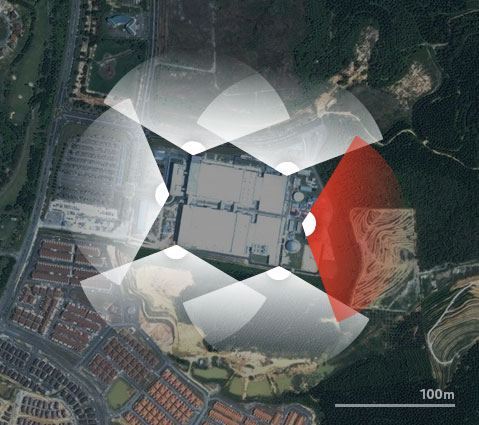

Ce concept de guerre infocentrée se nomme (dans l’US Navy) le Naval Fires Network et repose sur le système baptisé Cooperative Engagement Capability, (CEC) un réseau de capteurs et d’effecteurs permettant la fusion de données de capteurs, le contrôle des feux, la tenue d’une situation tactique partagée en temps réel. Du classique donc, sauf que l’US Navy compte y ajouter… de l’intelligence artificielle !

Pour être plus précis, l’US Navy a investi 2,5 milliards de dollars (oui, oui, milliards) pour développer un système appelé CANES (encore désolé pour les acronymes) pour Consolidated Afloat Networks and Enterprise Services ; un gros, un réseau de combat pour les navires de surface, dans le cadre du CEC. Ce réseau (dont plus de 50 systèmes sont aujourd’hui déjà opérationnels) doit être durci pour répondre aux impératifs de sécurité (protection contre les cyberattaques et communications sécurisées avec les terminaux durcis embarqués). Et c’est dans ce cadre que l’IA (Intelligence Artificielle) fait son apparition : il s’agit de pouvoir augmenter le niveau d’automatisation de CANES pour répondre aux différentes menaces.

L’US Navy, pour expliquer sa problématique, prend l’exemple du porte-avion nucléaire de classe Nimitz USS Truman. Son réseau CANES comporte plus de 3400 réseaux locaux (LAN), correspondant à plus de 2700 localisations différentes à l’intérieur du navire. Dans une telle complexité, il devient difficile à des analystes humains d’identifier une tentative d’attaque ou d’intrusion dans l’un de ces points de vulnérabilité. Il s’agit donc d’utiliser l’intelligence artificielle pour réduire le nombre d’analystes humains requis, et d’optimiser l’efficacité de la détection et de la sécurité.

Jusque là, même si la difficulté est réelle, il s’agit d’une utilisation classique de l’IA. Mais le concept va plus loin puisque la marine américaine souhaite que l’IA suggère, en cas d’attaque, les contre-mesures appropriées, voire suggérer des cyberattaques offensives menées par l’IA contre ses adversaires. Et le système est supposé apprendre de l’ensemble des menaces déjà détectées et identifiées. Comme le réseau agrège de nombreuses ressources, il s’agit bien de faire de l’IA, et de constituer un système adaptatif, apprenant de tout ce qu’il observe, et capable de généraliser, c’est à dire de mettre en oeuvre des stratégies fondées sur ce qu’il a appris. Big data, donc, mais pas seulement!

Mais cette introduction de l’IA dans le réseau va au-delà des préoccupations seules de cybersécurité : il s’agit également de pouvoir réaliser une analyse des données senseurs par exemple à des fins de maintenance prédictive des différents équipements. L’IA permet alors d’identifier les défaillances ou dérives avant qu’elles ne deviennent critiques : c’est par exemple le système ADEPT Distance Support Sensor Suite (ADSSS) que la société Mikros a récemment installé sur la frégate LCS USS Independence. Du point de vue de la cybersécurité, il s’agit également d’utiliser l’IA pour optimiser le déploiement de mises à jour ou de patchs de sécurité au sein du système CANES.

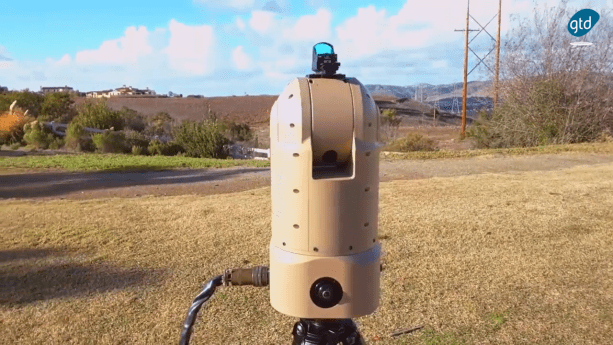

Au-delà, l’US Navy souhaite intégrer l’IA dans le contexte d’une aide tactique, et cela aussi, c’est nouveau. Il ne s’agit de pouvoir procéder à une analyse consolidée des données agrégées au niveau de la plate-forme LCS : imagerie, données SONAR, drones de type FireScout (ci-dessus), mais aussi d’utiliser l’IA pour aider à la coordination des feux dans une optique de protection collaborative.

Pas d’indication en revanche (et on le comprend) sur la nature des systèmes d’IA ou même leur famille. Si, dans le domaine cyber, les programmes sont déjà bien identifiés et sans doute facilement transposables dans le contexte du LCS, dans le domaine opérationnel tactique, aucune information ne filtre pour le moment. Mais nous resterons aux aguets.

Bonne année à vous tous – ce blog reprend son cours et vous souhaite en l’occurrence bon vent et bonne mer!