La vision artificielle a fait des progrès considérables dans ces dernières années, avec certes le développement de nouveaux capteurs, mais aussi en raison de l’apparition à la fois de processeurs spécialisés adaptés spécifiquement à cette problématique, et de nouveaux algorithmes, capables de fonctionner en temps réel, ce qui était inconcevable il y a quelques années. Dans ce domaine, de nombreuses sociétés apparaissent, mais celle-ci semble développer une approche originale, et que je pense assez adaptée (je vous dirai pourquoi).

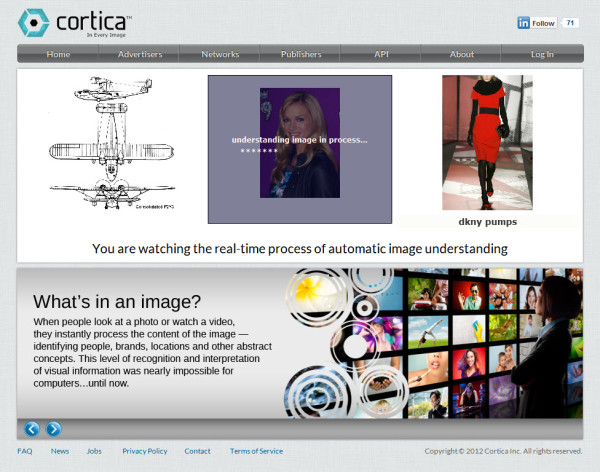

Cortica est une société israélienne, issue du célèbre Technion, l’équivalent israélien du MIT. La société a été fondée en 2007 par trois chercheurs spécialisés dans l’informatique, l’ingénierie et les neurosciences, dont son dirigeant actuel, Igal Raichelgauz. Après avoir levé un financement d’environ 40M$, la société compte aujourd’hui une équipe conséquente de chercheurs en IA, mais également des experts militaires issus de la communauté israélienne du renseignement ( !) ce qui en dit long sur les applications visées.

L’approche de CORTICA est résolument inspirée par la biologie, et en particulier par le fonctionnement du cortex visuel primaire. Elle développe en effet une technologie d’apprentissage non supervisé (pour faire simple, je rappelle que l’apprentissage non supervisé a pour objectif de découvrir de la valeur dans des données qui ne sont pas structurées a priori, afin de réaliser une extraction de connaissances) afin de disposer d’une IA capable de comprendre l’image « comme un humain ».

En gros, l’IA cherche à identifier par elle-même des caractéristiques, des motifs (patterns), des relations entre différentes images, et ce de manière autonome, l’ambition étant – je cite – de constituer « un index universel visuel du monde ». Pour ce faire, la société a conçu une architecture d’apprentissage qui s’inspire du cortex visuel primaire des mammifères – peu de détails ont filtré, mais on peut imaginer en particulier qu’il s’agit de coder ce que l’on appelle des neurones à spikes – pour une description plus détaillée, je vous propose de relire cet article.

Cette architecture cherche à permettre un apprentissage non supervisé par observation, ce que l’on pourrait appeler de l’apprentissage prédictif (c’est le terme employé par Yann le Cun, chercheur en IA et directeur du laboratoire parisien d’IA de Facebook). En gros, au lieu de devoir constituer de grosses bases de données d’images « labellisées », donc traitées au préalable afin d’expliquer au système ce qu’il est supposé reconnaître, on présente à l’IA des images, et – comme un nouveau-né qui commence à observer le monde – elle apprend progressivement le sens et les relations entre ces différentes images présentées. Si je crois particulièrement à cette approche et surtout à l’inspiration biologique du cortex visuel primaire, c’est parce que dans ma – de plus en plus lointaine – jeunesse, j’ai travaillé au sein du groupe de bioinformatique de l’Ecole Normale Supérieure sur le sujet de l’apprentissage et de la vision active, inspirée de la modélisation des colonnes corticales du cortex visuel primaire, et que les résultats préliminaires, alors limités par la puissance de calcul dont nous disposions à l’époque, étaient déjà encourageants.

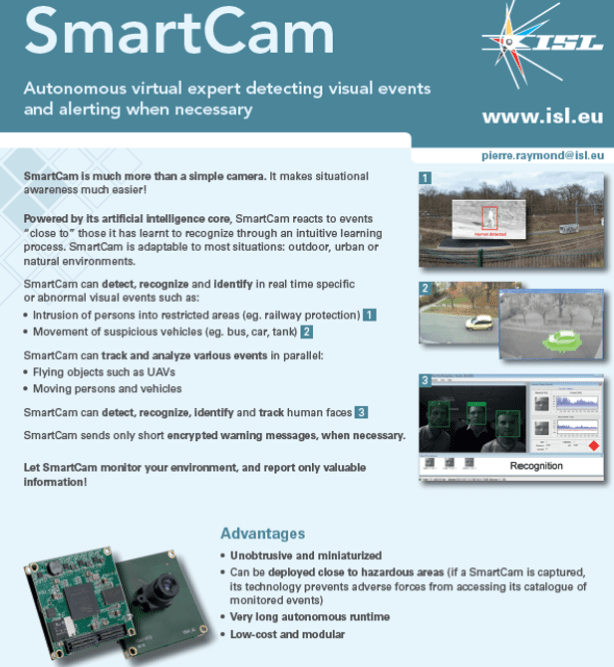

Cortica vise à déployer sa technologie en l’embarquant dans différents systèmes, qu’il s’agisse de véhicules autonomes, de systèmes automatiques d’analyse d’imagerie médicale, ou d’applications grand public. Mais on voit immédiatement le potentiel d’une telle technologie dans le domaine de la défense et de la sécurité. Le ROIM (renseignement d’origine image) a besoin de telles technologies afin de pouvoir très rapidement générer des « points d’attention » sur des images (images satellites, caméras de surveillance…) et leur donner du sens.

Il s’agit donc d’une tendance de fond en IA, qui bénéficie directement à la Défense, et qui est d’ailleurs accompagnée par l’émergence de nouveaux moyens de calcul dédié. Google a présenté récemment son Tensor Processing Unit (ci-dessus, et voir ce lien) qui met en œuvre une accélération hardware des réseaux de type Deep Learning. Mais les réseaux de neurones à spikes – tels que ceux a priori mis en œuvre dans la technologie de Cortica – connaissent un développement important, également en France.

Nous avions parlé dans ce blog du projet AXONE (ci dessous) soutenu par la DGA. Simon Thorpe, le chercheur à l’origine de cette technologie, dirige le CERCO, Centre de recherche sur le cerveau et la cognition (Cerco) – rattaché au CNRS et à l’université Toulouse-III. Via la structure Toulouse Tech Transfer (TTT), il vient de céder une licence d’exploitation de sa technologie de reconnaissance à BrainChip, spécialiste des solutions de reconnaissance pour la surveillance civile et qui avait racheté en septembre la société Spikenet Technology.

BrainChip utilisera cette technologie en vue d’optimiser son microprocesseur Snap, qui analyse en temps réel des flux vidéo. La tendance de fond semble donc se confirmer, avec de nouveaux acteurs en parallèle des Google, Facebook et autres géants, et avec des applications potentiellement considérables dans le domaine de la Défense et de la Sécurité. En attendant leur portage sur de futurs processeurs neuromorphiques, mais c’est une autre histoire.

Pour faire écho à mon récent billet d’humeur, on voit donc que les technologies d’IA commencent à atteindre un degré de maturité considérable, et suscitent un intérêt certain dans nombre de pays compte tenu des enjeux sous-jacents. A la France de maintenir et d’amplifier l’avance qu’elle possède dans le domaine.