Il s’appelle DAVD mais certains l’appellent déjà DAVID, pour Divers Augmented VIsion Display (système d’affichage en vision augmentée pour plongeurs) et c’est le tout premier dispositif permettant d’afficher des indications en vision augmentée pour des nageurs de combat, pendant leur mission.

On rappelle pour mémoire que la vision augmentée permet de superposer des indications synthétiques dans le champ visuel d’un opérateur ; l’exemple le plus connu est le HUD (affichage tête haute ou head-up display) des pilotes (de chasse comme de transport) permettant de visualiser les informations de pilotage, tactiques ou relatives à l’état de l’avion directement dans leur champ visuel. Avec la miniaturisation des moyens de calcul, et la maturité et la résolution des systèmes de génération d’image, cette technologie tend à se généraliser.

La réalité augmentée, quant à elle, va un cran plus loin, puisqu’il s’agit de superposer ces informations synthétiques en parfaite cohérence avec l’environnement réel de l’opérateur. C’est par exemple le cas dans le domaine en plein essor de la simulation embarquée dynamique, ou des avatars virtuels d’entités sont injectés sur le champ de bataille réel, en cohérence avec les mouvements du terrain. J’avais également mentionné dans cet article les différents projets visant à doter les fantassins de telles capacités (photo ci-dessous).

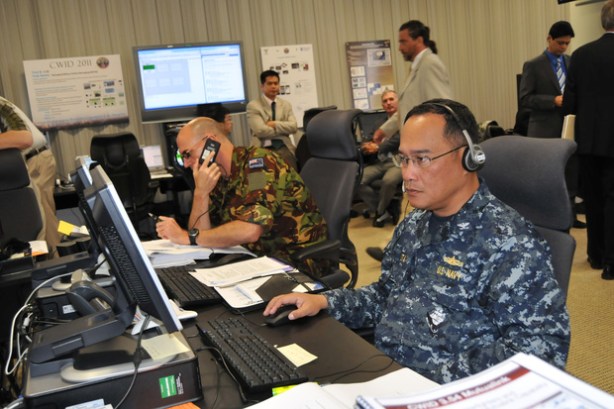

Il s’agit donc d’une tendance de fond, comme le montre ce nouveau développement piloté par l’US Navy, en l’occurrence le Naval Surface Warfare Center Panama City Division (NSWC PCD). L’idée ici est de transmettre au plongeur des informations directement dans son champ de vision : informations tactiques, messages, mais également représentation de l’imagerie sonar générée par le bateau situé en surface, au-dessus de lui.

Pour ce faire, les ingénieurs de l’US Navy ont eu l’idée de construire un casque de plongée intégrant directement un dispositif de réalité augmentée devant les yeux du nageur. Il s’agit de lunettes semi-transparentes capables de restituer à l’utilisateur des informations en haute définition. Le plongeur peut choisir d’activer ou non l’affichage en fonction de la complexité des opérations qu’il doit effectuer. Il peut également choisir de repositionner lui-même les informations dans son champ de vision. Cette fonction a d’ailleurs été mise au point après le retour d’expérience de différents plongeurs ayant testé le système.

Il s’agit bien de vision augmentée puisque les informations sont « indicatives ». L’étape suivante consistera à munir le plongeur lui-même de microsonars lui permettant de superposer l’imagerie obtenue (de son point de vue) avec le terrain réel – une fonction très utile lorsque l’environnement est obscur et troublé. Il s’agira alors véritablement d’un dispositif de réalité augmentée.

On pourra également imaginer superposer des informations simulées avec la vision réelle de l’opérateur, pour l’assister par exemple dans des tâches de maintenance sous-marine ou de déminage. Les applications dérivées pour le civil sont évidentes, avec un intérêt marqué pour l’archéologie sous-marine.

Un essai sur le terrain de cette première version est prévu dès le mois d’octobre 2016 avec une vingtaine de plongeurs-testeurs, pour une phase étendue de tests opérationnels en 2017.