« je le croirai quand je le verrai » : jamais cette affirmation n’a été aussi risquée qu’aujourd’hui, alors qu’Internet regorge d’images supposées refléter la réalité. La photo-portrait prétendue du cadavre de Ben Laden (que je me suis permis de flouter, parce que bon…), des photo-reportages dénonçant des violences policières à Chypre, ou des images de propagande gouvernementale … tous ces éléments, puisqu’ils sont visuels, nous semblent naturellement authentiques. Mais aujourd’hui, les logiciels de retouche photo sont sophistiqués, et nombre de ces éléments sont en fait fabriqués de toutes pièces. Fort heureusement, des solutions permettant de les démasquer existent – Aujourd’hui, focus sur eXo maKina, une société 100% française qui en a fait son cœur de métier.

Son fondateur et dirigeant, Roger Cozien, avec qui j’ai eu le plaisir de m’entretenir, est un expert en informatique et photographie. La société est surtout connue pour son logiciel Tungstene Factory, un logiciel impressionnant que l’on pourrait qualifier de plate-forme de photointerprétation, et permettant de savoir si une photo a été ou non manipulée ou éditée, et ce à des fins purement esthétiques, ou en vue de la truquer.

Considérons par exemple la photo suivante prise lors d’émeutes à Chypre, et utilisée ensuite à des fins de propagande anti-gouvernementales pour dénoncer des violences policières (Nota : toutes les images de cet article sont © eXo maKina). Cette image est-elle authentique ? Le policier de face porte-t’il réellement un coup de poing américain à la main droite ?

Le logiciel dispose d’une palette d’outils, permettant à l’opérateur d’appliquer des filtres et de procéder à l’analyse d’une image selon plusieurs axes : détection des ruptures dans les statistiques profondes de l’image (excavation des pixels identiques, par exemple, ou déformation des contours), détection des incohérences dans les aspects physiques de l’image (diffusion de la lumière, chrominance, luminance…), modification du bruit électronique, analyse des données EXIFS, de l’histogramme, etc… Il s’agit donc d’une plate-forme complète, destinée à assister l’expert dans son analyse. Le système fonctionne soit de manière autonome, soit en utilisant une base de données de référence.

Appliquée à l’image ci-dessus, le résultat est édifiant : le logiciel détecte des anomalies et permet d’affirmer que l’image a subi une intrusion – de fortes manipulations et une post-production importante :

Des zones altérées sont mises en évidence :

Confirmées par des anomalies dans le bruit électronique de l’image sur certaines zones :

En résumé, les outils utilisés mettent en évidence que l’image a été modifiée en vue de faire passer un message politique :

Dans ce cas, la modification n’est pas purement esthétique : l’arrière-plan a été nettoyé afin de mettre en évidence les sujets au premier plan, mais au-delà, le mot « Police » sur le dossard a été profondément travaillé, ainsi que le coup de poing américain visible sur la main du policier. Même si l’on ne peut reconstituer l’image originelle, il est possible d’affirmer que la photo a subi trop de manipulations pour être authentique, il est impossible d’en tirer une quelconque information.

Dans d’autres cas, même si l’image semble suspecte, le logiciel permet de montrer que les modifications sont uniquement à visée photographique, afin d’améliorer la qualité visuelle de l’image. C’est le cas de cette photo de la manifestante Rachel Corrie, s’opposant à des bulldozers israéliens venus raser une maison à Gaza – elle sera d’ailleurs tuée par le bulldozer. Des réserves avaient été émises sur l’authenticité de la photo (problèmes supposés d’échelle entre la manifestante et le véhicule, ombres projetées…). Appliquée à cette photo, la technologie Tungstene permet d’en prouver l’authenticité : les modifications et éditions sont simplement le résultat d’un travail photographique classique.

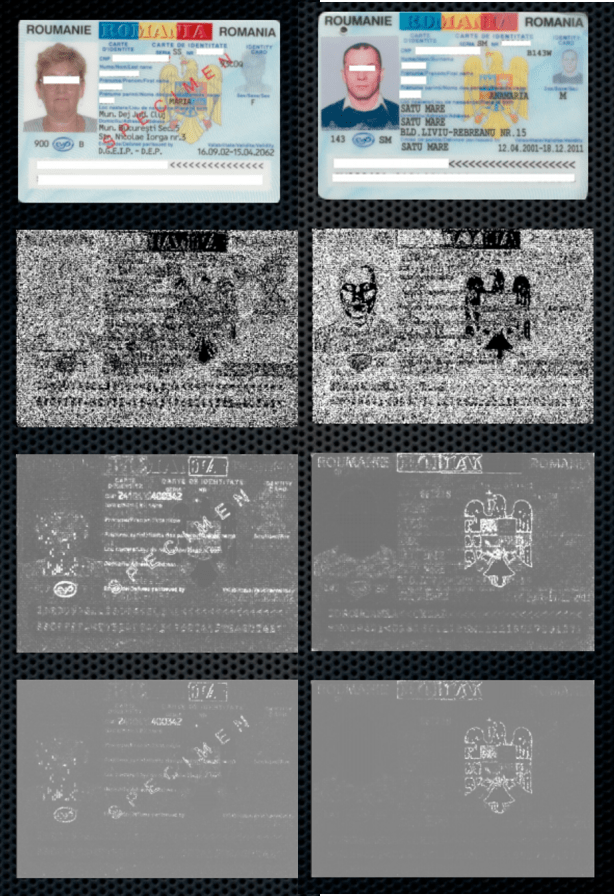

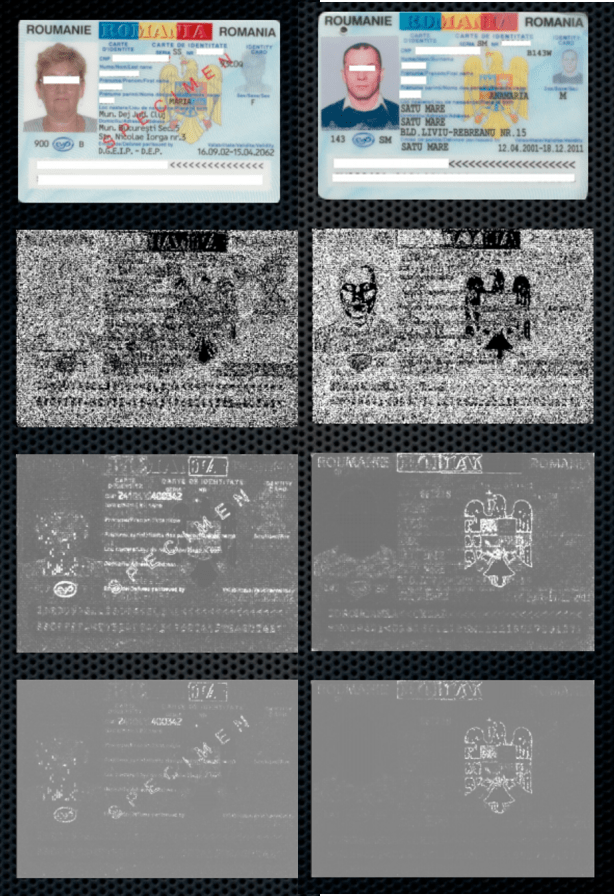

Au-delà de l’interprétation des photos journalistiques, la société a également conçu TUNGSTENE RITUEL, une solution permettant, uniquement par analyse d’images, de détecter des contrefaçons de documents (en particulier de documents d’identité). L’intérêt est de ne pas nécessiter la présence physique de la pièce à analyser: tout peut se faire à distance puisque seule l’analyse de l’image est employée. De plus, dans la plupart des cas, le papier est authentique, ainsi que les encres. C’est donc l’analyse poussée de l’image et elle seule qui permet d’en établir ou non l’authenticité.

eXo maKina ne s’arrête pas là. Le 1er janvier 2016, la société va lancer HELIUM 3, une plate-forme pour fournir des technologies d’amplification multispectrale et de vision nocturne, pour l’analyse de vidéos. L’objectif est d’amplifier les vidéos sombres ou sous-exposées (débruitage, amplification intelligente, extraction de mouvement) de façon passive, en direct ou a posteriori, et en outre de calculer la vitesse relative des sujets observés par rapport au capteur. Les premières images divulguées sont impressionnantes : voici l’image issue de la vidéo initiale

Et l’amplification réalisée par HELIUM 3 :

Ici, l’image est analysée pour permettre le calcul automatique de la vitesse relative de déplacement du sujet :

Et enfin, une photo originale – vous conviendrez qu’elle est nettement sous-exposée ( !!!)

Et l’information récupérée par HELIUM 3.

Ces résultats impressionnants reposent donc sur une palette de compétences, une suite d’outils et d’algorithmes (ainsi qu’une méthodologie permettant de les mettre en œuvre de manière cohérente), mais aussi des compétences très pointues en termes de R&D. D’ailleurs, dans le domaine, des défis persistent : certains types de falsification de documents sont plus résistants que d’autre à l’analyse, mais surtout, le défi principal demeure la quantité massive de données à analyser. Pour pouvoir utiliser de telles techniques sur un smartphone ou un portable, il faut encore résoudre des problèmes de transport parcimonieux des images, de compression, etc…) ; c’est aujourd’hui la feuille de route de R&D de la société, qui a déjà plusieurs brevets à son actif.

Ah, et au fait, la photo de Ben Laden ? Tungstene a permis (ci-dessus) de démontrer qu’il s’agit d’un photomontage incontestable, avec des différences très claires, par exemple, entre la signature électronique du capteur qui a pris la photo originale de Ben Laden (à gauche) et celle qui a pris les photos d’une dépouille mortelle anonyme (à droite). Plus jamais vous ne croirez ce que vous verrez…

Crédits images © eXo maKina

Pour contacter Roger Cozien : communication@exomakina.fr

Et pour ceux que cela intéresse, voici un lien vers les publications d’eXo maKina